Dunia perangkat lunak sumber terbuka terus memberikan kesempatan bagi perusahaan untuk membedakan dirinya dari raksasa AI generatif seperti OpenAI dan Google. Pada hari Rabu, vendor cloud data warehousing Snowflake diumumkan model AI sumber terbuka yang menurut perusahaan bisa lebih efisien daripada Llama 3 yang baru-baru ini diperkenalkan Meta pada tugas-tugas perusahaan, seperti pengkodean SQL untuk pengambilan basis data.

Juga: AI21 dan Databricks menunjukkan bahwa open source dapat mengurangi AI secara radikal

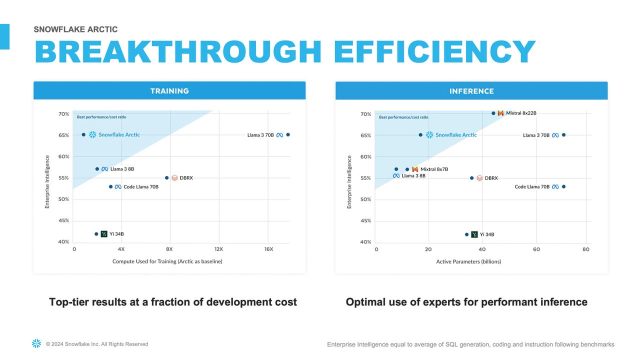

Model bahasa besar (LLM), yang disebut Arctic, “setara atau lebih baik daripada Llama 3 8B dan Llama 2 70B dalam metrik perusahaan, namun menggunakan kurang dari setengah anggaran komputasi pelatihan,” Snowflake klaim pada repositori GitHub-nya.

Snowflake telah merilis semua parameter dan kode model Arctic di bawah lisensi sumber terbuka Apache 2.0, bersama dengan “resep data” untuk pelatihan yang diusulkan oleh perusahaan, dan kumpulan wawasan penelitian. A Repositori Memeluk Wajah tersedia juga.

“Ini adalah momen penting bagi Snowflake, dengan tim peneliti AI kami yang berinovasi di garis depan AI,” kata CEO Snowflake Sridhar Ramaswamy dalam sambutannya.

Snowflake menekankan kemampuan Arctic untuk bertahan melawan Llama 3 dan DBRX, tidak hanya pada tugas-tugas perusahaan tetapi juga pada tolok ukur pembelajaran mesin umum seperti tugas pemahaman tekstual “MMLU”:

Demikian pula, meskipun menggunakan anggaran komputasi 17x lebih sedikit, Arctic setara dengan Llama3 70B dalam metrik perusahaan seperti Coding (HumanEval+ & MBPP+), SQL (Spider), dan Instruksi Mengikuti (IFEval). Ia melakukan hal tersebut namun tetap kompetitif dalam performa keseluruhan, misalnya, meskipun menggunakan komputasi 7x lebih sedikit dibandingkan DBRX, ia tetap kompetitif dalam Pemahaman dan Penalaran Bahasa (kumpulan 11 metrik) sekaligus lebih baik dalam Matematika (GSM8K).

Snowflake belum menerbitkan makalah resminya, tetapi perusahaan telah menawarkan beberapa rincian teknis di GitHub. Pendekatan yang diambil oleh pimpinan AI Snowflake — Yuxiong He, Samyam Rajbhandari, dan Yusuf Ozuysal — mirip dengan pendekatan yang baru-baru ini dilakukan oleh vendor database Databricks dengan DBRX LLM-nya dan oleh startup AI AI21 Labs dengan Jamba LLM-nya.

Juga: Bagaimana Llama 3 Meta akan diintegrasikan ke dalam asisten AI-nya

Pendekatannya menggabungkan pendekatan tradisional model berbasis perhatian transformator dengan apa yang disebut “campuran para ahli” (MoE), sebuah pendekatan LLM yang mematikan beberapa bobot saraf untuk menghemat kebutuhan komputasi dan memori. MoE adalah salah satu alat yang digunakan Google untuk Gemini LLM terbarunya.

Snowflake menyebut variannya sebagai “Dense – MoE Hybrid Transformer” dan menjelaskan cara kerjanya sebagai berikut:

Arctic menggabungkan model trafo padat 10B dengan sisa MLP MoE 128×3,66B yang menghasilkan total 480B dan parameter aktif 17B yang dipilih menggunakan gerbang 2 teratas. Untuk detail lebih lanjut tentang Arsitektur model Arktik, proses pelatihan, data, dll.

Sebagai pengganti makalah formal, Snowflake telah menerbitkan dua postingan blog untuk membahas pendekatan dan prosedur pelatihan sebagai bagiannya halaman web Arctic Cookbook yang berkembang.

Ada juga sebuah demo of Arctic menyediakan inferensi, makna, membuat prediksi, dalam bentuk chat prompt, di repositori Hugging Face.

Juga: Saya menguji Kode Llama Meta dengan 3 tantangan pengkodean AI yang unggul dari ChatGPT – dan hasilnya tidak bagus

Ketika ZDNET meminta perintah Arktik untuk menjelaskan perbedaan antara dua versi Arktik, “base” dan “instruct”, ZDNET menghasilkan ringkasan yang layak dalam sekejap, dengan mencatat bahwa “Arctic Instruct adalah varian dari model Arctic Base yang secara khusus dirancang untuk mengikuti instruksi dan percakapan berorientasi tugas.”

Arktik mengikuti Rilis Snowflake awal bulan ini dari rangkaian “model penyematan teks”, yang unggul dalam menentukan cara kata-kata dikelompokkan untuk pengambilan, seperti yang digunakan untuk penelusuran.